| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | |||

| 5 | 6 | 7 | 8 | 9 | 10 | 11 |

| 12 | 13 | 14 | 15 | 16 | 17 | 18 |

| 19 | 20 | 21 | 22 | 23 | 24 | 25 |

| 26 | 27 | 28 | 29 | 30 | 31 |

- SSL

- Front

- FineGrained

- 3d

- pytorch

- Depth estimation

- Python

- nerf

- PRML

- Meta Learning

- algorithm

- 머신러닝

- computervision

- 알고리즘

- classification

- clean code

- CV

- nlp

- Vision

- FGVC

- ML

- GAN

- cs

- REACT

- Torch

- dl

- 딥러닝

- web

- 자료구조

- math

- Today

- Total

KalelPark's LAB

[논문 리뷰] Progressive Multi Granularity [2020] 본문

[논문 리뷰] Progressive Multi Granularity [2020]

kalelpark 2022. 11. 30. 12:16

GitHub를 참고하시면, CODE 및 다양한 논문 리뷰가 있습니다! 하단 링크를 참고하시기 바랍니다.

(+ Star 및 Follow는 사랑입니다..!)

https://github.com/kalelpark/Latest_Progressive-Multi-Granularity-Training-of-Jigsaw-Patches

GitHub - kalelpark/Latest_Progressive-Multi-Granularity-Training-of-Jigsaw-Patches: Fine-Grained Visual Classification via Progr

Fine-Grained Visual Classification via Progressive Multi-Granularity Training of Jigsaw Patches - GitHub - kalelpark/Latest_Progressive-Multi-Granularity-Training-of-Jigsaw-Patches: Fine-Grained Vi...

github.com

Abstract

Fine Grain Classification은 traditional classification보다, 클래스 내 미묘한 차이로 인하여, 더 어렵습니다.

본 논문에서는 어떤 세분화가 가장 차별적이며, 다중 세분화를 통하여, 정보를 융합하는 새로운 기법을 제안합니다. 본 논문에서는 2가지 방법을 제안합니다.

- layer로부터, 세분화된 정보를 기반으로 정보를 추출하여, layer에 추가적인 학습 전략을 제안합니다.

- Image를 형성하는 간단한 jigsaw puzzle은 다양한 세부적인 수준의 정보를 포함합니다.

Introduction

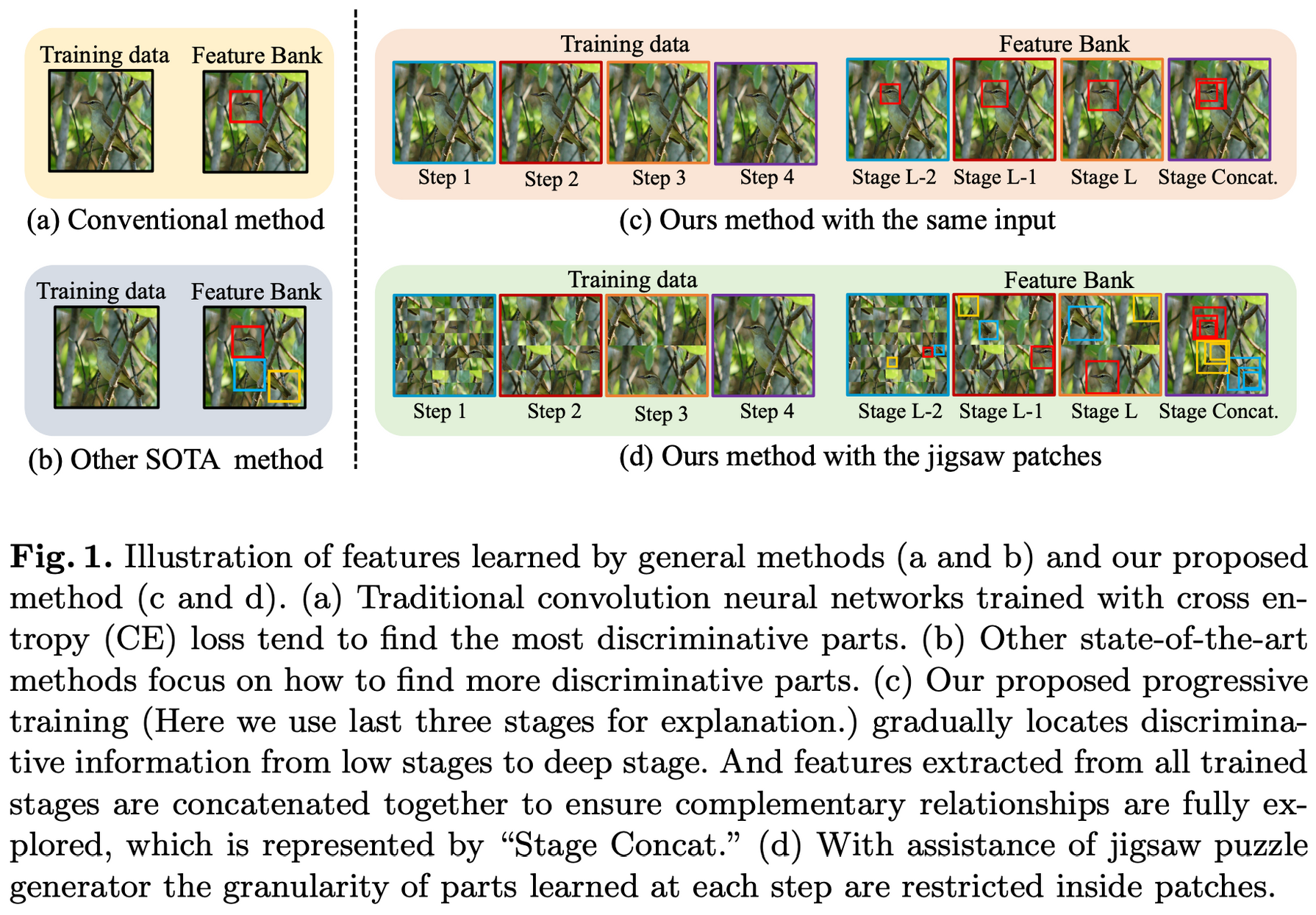

본 연구에서는, 세분화된 분류에 관하여, 대안적인 입장을 취합니다. 우리는 세부적인 부분으로부터, 세밀한 표현을 명시적으로 마이닝하거나, 암시적으로 시도하지 않습니다.

세분화된 차별적인 정보는 자연스럽게, 다른 시각적 세분화 내에 있다는 가설로 문제에 접근합니다. 이는 네트워크가 서로 다른 세분성과 융합된 feature들을 학습하도록 장려합니다.

부분 세분화 학습과 교차 적합성 기능 융합을 동시에 수용하는 Framework를 제안합니다. 이러한 각 구성 요소와 시너지 효과를 발휘하는 두 가지 구성 요소를 통해 달성합니다.

- 다양한 세분화의 기능을 효과적으로 융합하는 점진적인 교육 전략

- 특정 세분화된 기능을 학습하는 네트워크입니다.

이미지를 학습할 때, Image patch에 Gaussian blur를 적용하지 않기에, Scale하여, 이미지를 학습합니다.

우리는 다른 세분화 수준의 형태로 이미지를 균등하게 나누고, 분할합니다.

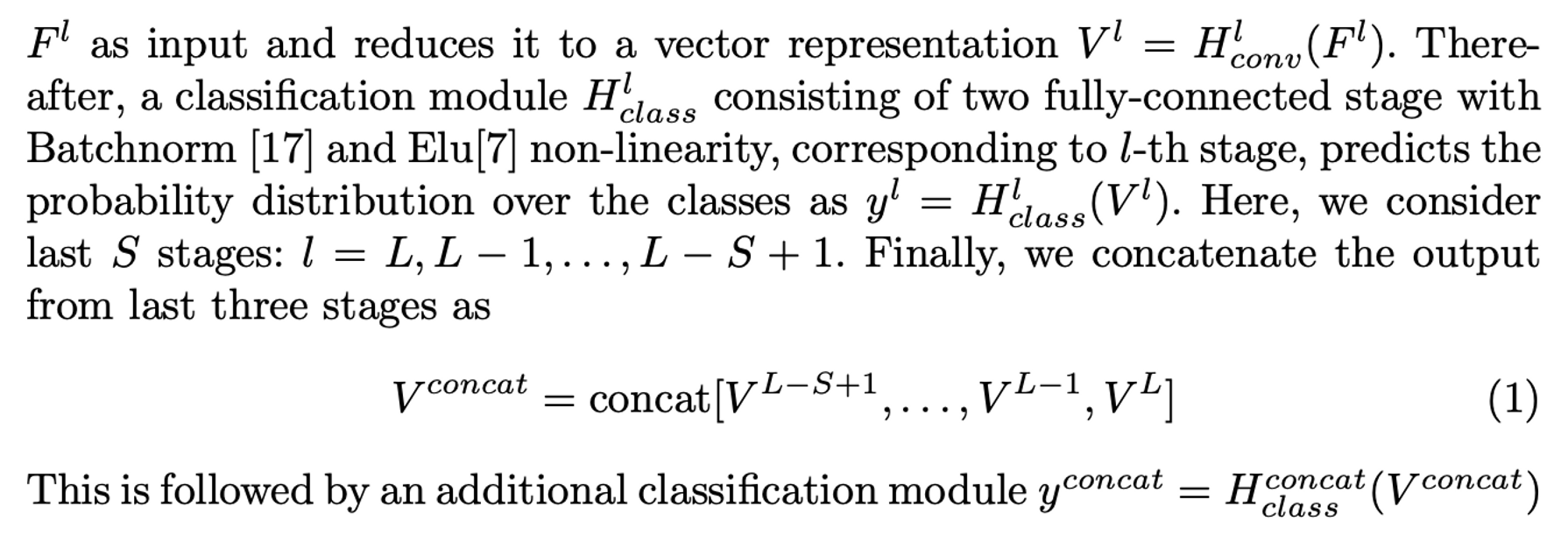

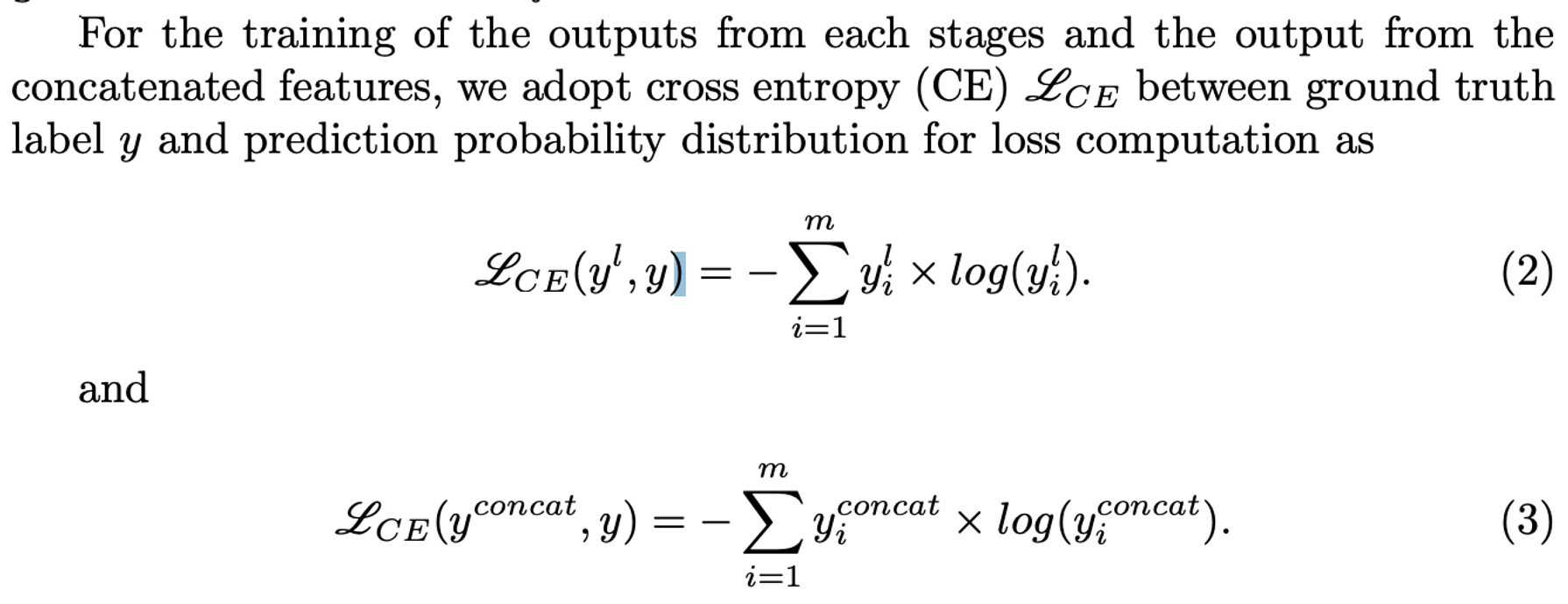

첫 번째로, 서로 다른 이미지의 세분성으로부터 정보를 보완하면서, 학습하기 위해 우리는 multi-granularity progressive training framework방식을 제안합니다.

이는 부분이 처음 검출된 선행기술과 크게 다릅니다. 나중에 임시적으로 융합되어 활용됩니다.

본 모델은 각각의 네트워크에서 세분화된 특정 정보를 배양하는데 중점을 두어 학습을 진행합니다.

모델이 학습을 진행할 때, 미묘하고, 세부적인 부분에서, 점진적으로 거친 부분으로 학습을 진행합니다. 이러한 방식은 large regions에서 나타나는 클래스의 변형으로 인한 혼란을 회피합니다.

이러한 작업을 통하여 네트워크는 기본적으로 이전 교육 단계에서 학습한 영역을 기반으로, 더 큰 세분화된 정보를 얻는 것이 가능합니다.

모든 단계에서의 추출된 feature는 마지막 layer에서만 연결되어 완전히 탐색하는 것이 가능하도록 합니다.

Summarize

- different traing steps를 활용합니다. 그리고, 각 단계에서 이전 수준의 세분화된 데이터를 융합하여, 궁극적으로 서로 다른 세분화에 걸쳐 고유한 보완적 특성을 배양합니다.

- 우리는 간단하지만, 효과적인 jigsaw puzzle 생성기를 적용하여, 다양한 수준의 세분화를 형성합니다. 이러한 방법은, network가 다양한 scales로부터 학습을 하는 것을 가능하게 합니다.

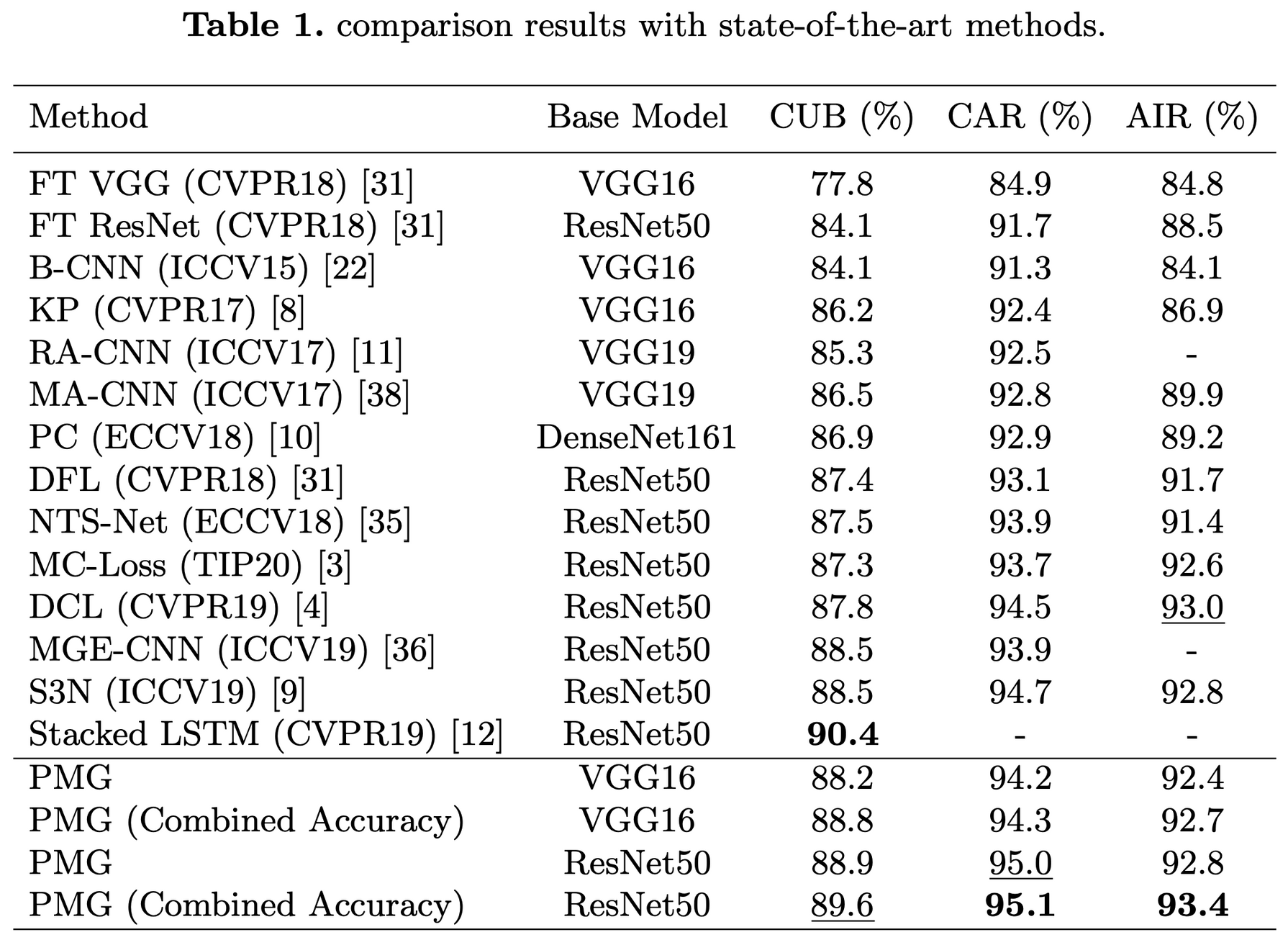

- Progressivef Multi-Granularuty (PMG) 방법은 일반적인 FGVC에서 SOTA를 달성하였습니다.

Related Work

Fine-Grained Classification

본 연구에서는, fine-grained objects의 본질적인 특징을 다루려고 합니다. 비록 클래스 내에는 변동이 많지만, 이러한 미묘한 세부 사항은 local regions에서 안정성을 보여줍니다. 이러한 이유로, 차별적인 부분을 먼저 찾는 것 대신에, 우리는 Network가 미묘한 부분부터, 큰 부분까지 학습하는 순으로 진행을 합니다.

Image Splitting Operation

이전의 DCL에서는 Image를 destructing을 진행하여, local regions에서, semantic correlation을 학습하도록 합니다. 하지만, 훈련 과정에서 동일한 크기의 이미지를 분할하므로 multi-granularity region을 exploit하기에 상당히 어렵습니다.

이러한 방식은, 각 훈련 단계에서 학습된 영역의 세분성을 제한하기 위하여, jigsaw puzzle generator를 활용합니다.

Progressive Training

이러한 전략은 Network가 Image distribution의 large-scale structure가 Image distribution을 학습하도록 합니다. 그리고 점점 더 세부사항으로 확장하도록 합니다. 이러한 방법은 network내에서 쉽게 활용하는 것이 가능합니다.

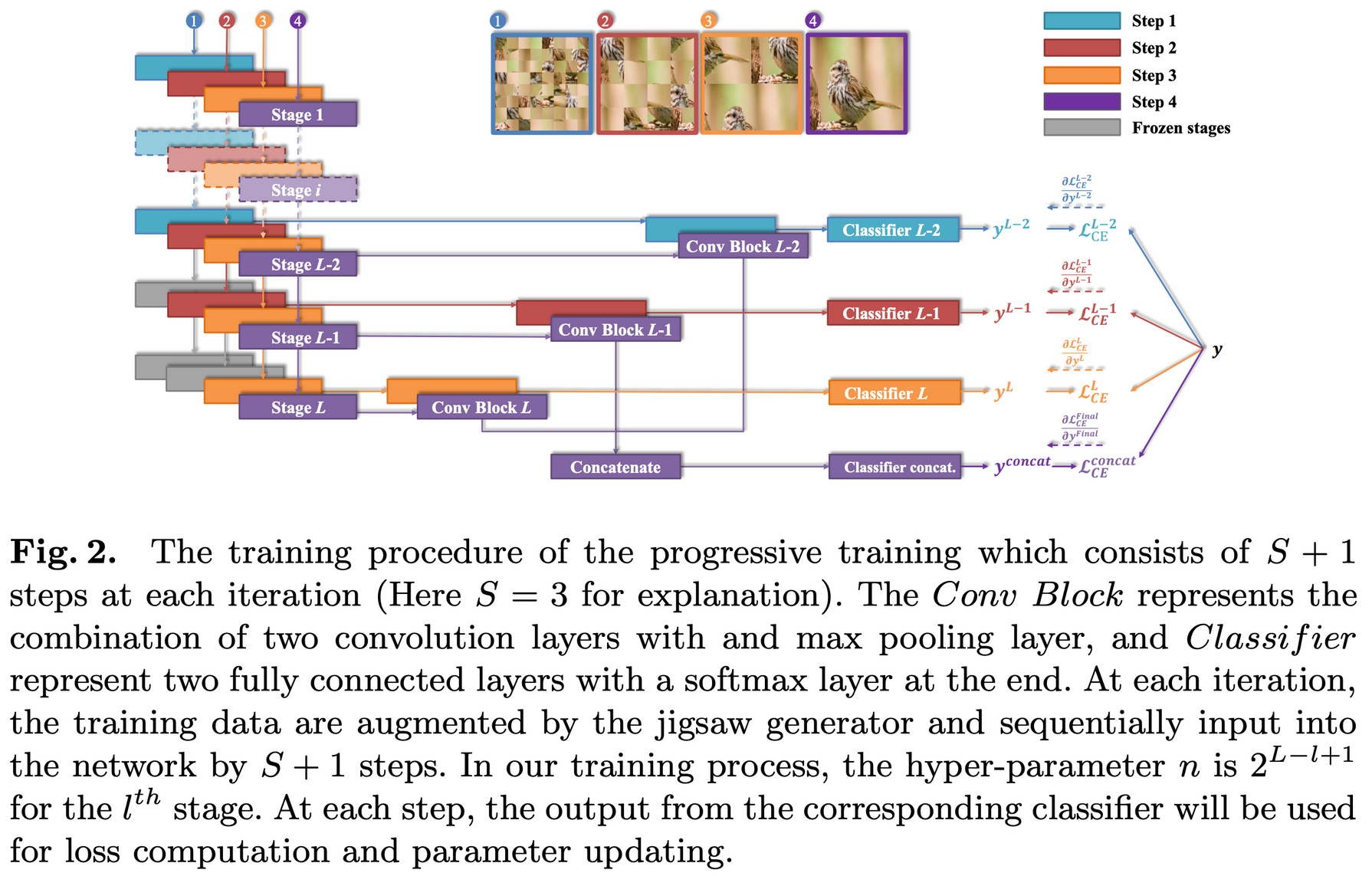

본 연구에서는 먼저, Input Image를 model의 low-level layers에서 train하기 위해, small patch로 분할합니다. 이후, patches의 개수는 점점 증가하고, layer의 개수가 점점 추가되고, 학습을 진행하게 됩니다.

Framework

Approach

Network Architecture

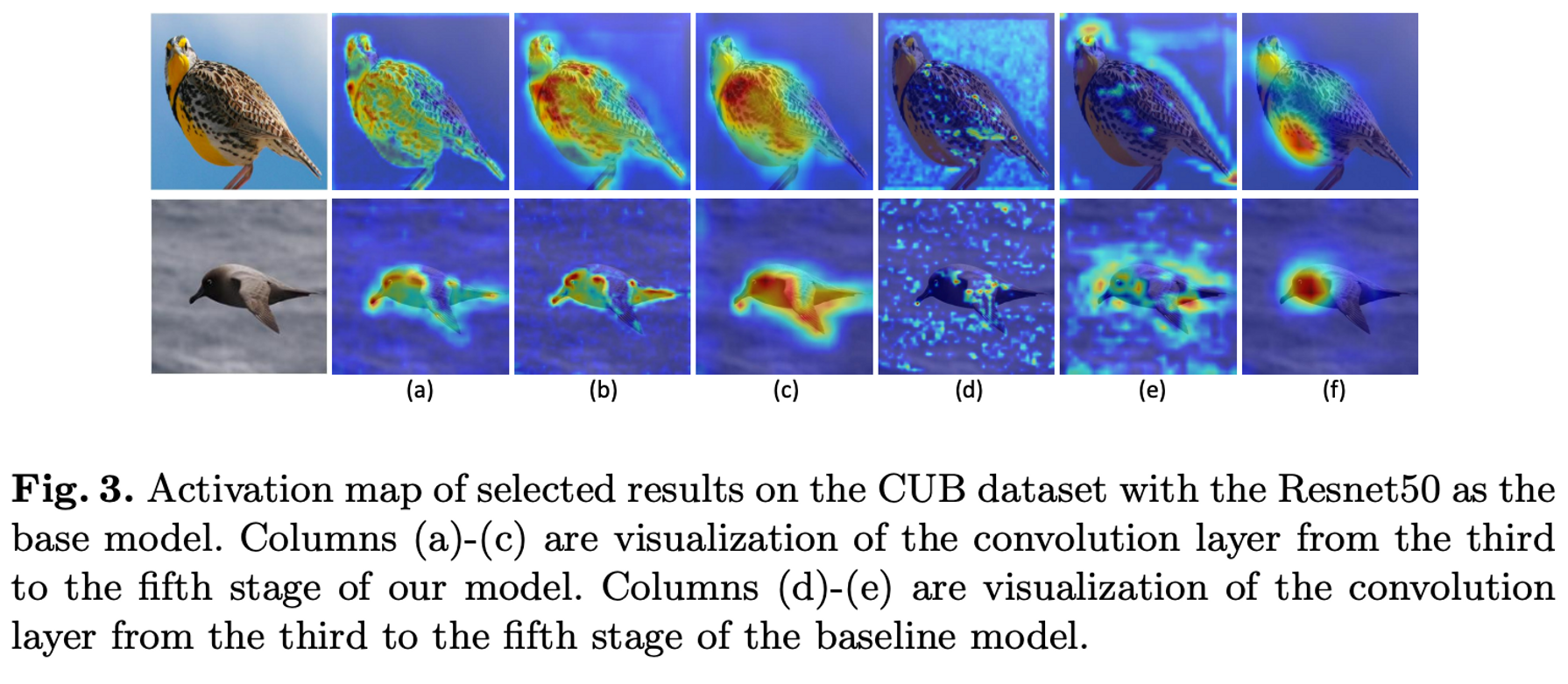

수 많은, 클래스를 다루기 위해서, 우리는 shallower layers에서 stable fine-grained information을 학습하도록 합니다. 그리고, 점진적으로 학습이 deep layers로 진행함에 따라, 큰 세부적인 수준의 추가적인 정보를 학습하는데, 주의를 돌립니다.

Progressive Training

우리는 점진적으로 학습을 진행합니다. low stage first부터 시작하여, 점진적으로 새로운 stage를 학습을 위해 추가적으로 도입합니다. reeptive field와 low stage 표현력이 제한되기 때문에, local details로부터, 차별적인 정보를 추출하는데 초점을 뒵니다.

이러한 특성은 모델이 local details로부터, global structures까지 차별적인 정보를 얻는 것을 허용합니다.

Jigsaw Puzzle Generator

Jigsaw Puzzle Generator는 representation learning에 있어, self-supervised task에 관해서, 적합합니다. 목표는 다양한 세분화 영역을 고안하고, 모델이 각 교육 단계에서 해당 세분화 수준에 특정한 정보를 학습하도록 하는 것입니다.

Small discriminative parts은 또 다른 iterations에서 항상 split하지 않습니다. 그러한 까닭에, 우리의 모델이 추가적인 advantage를 가져오도록 합니다.

Experiments

Conclusion

본 논문에서는 progressive training 전략을 fine-grained classification task에서 활용하고, Progressive Multi-Granularity 방법을 제안합니다.

Progressive Multi-Granularity는 2가지로 이루어져 있습니다.

- novel training strategy는 progressive manner에서 multi-granularity features를 혼합합니다.

- Image내에서 형성된 jigsaw puzzle generator는 different granualarity levels의 정보를 얻는 것이 가능합니다.

본 연구에서의 전략은 annotataion없이, end-to-end로 학습하는 것이 가능합니다. 그리고, Single Network로 학습을 진행하는 것이 가능합니다.

GitHub를 참고하시면, CODE 및 다양한 논문 리뷰가 있습니다! 하단 링크를 참고하시기 바랍니다.

(+ Star 및 Follow는 사랑입니다..!)

https://github.com/kalelpark/AI_PAPER

GitHub - kalelpark/AI_PAPER: Machine Learning & Deep Learning AI PAPER

Machine Learning & Deep Learning AI PAPER. Contribute to kalelpark/AI_PAPER development by creating an account on GitHub.

github.com

'Data Science > Fine Grained' 카테고리의 다른 글

| [논문 리뷰] TransFG [2021] (0) | 2022.12.10 |

|---|---|

| [논문 리뷰] PIM(Plug in Module) [ 2022 ] (0) | 2022.12.06 |

| [논문 리뷰] Counterfactual Attention Learning [2021] (0) | 2022.12.05 |

| [논문 리뷰] Look into Object [2020] (0) | 2022.12.03 |

| [논문 리뷰] Mixture Granularity Specific Expert [2019] (0) | 2022.11.29 |